NLP pour les sciences sociales

Fini les méthodes du passé !

IAE Amiens - UPJV

sophie.balech@u-picardie.fr

08/02/2024

Introduction

Objectif : Présenter un panorama des méthodes NLP

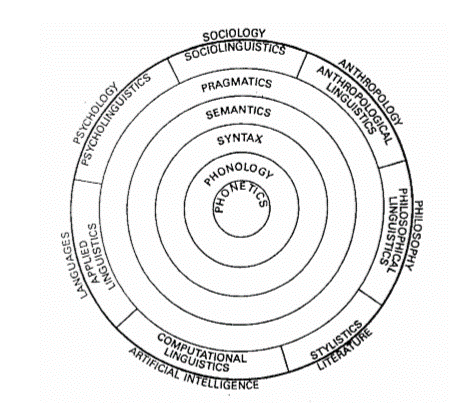

Natural Language Processing / Traitement Automatique du Langage :

Traiter des données textuelles massives

Assisté par ordinateur : logiciels dédiés, langages informatiques (R, Python)

Pour répondre à une problématique de recherche spécifique

Quelles sources de données ?

Quelles applications ?

Quelles méthodes d’analyse ?

Quelles difficultés ?

1. Quelles sources de données ?

Tous types de corpus de textes :

des articles : journalistiques, scientifiques, …

des rapports : publics, d’entreprises, …

des publications artistiques : littérature, paroles, synopsis, …

des manuels : scolaires, des essais, …

des discours / prises de parole : politiques, syndicalistes, …

des contenus générés par les utilisateurs (UGC) : réseaux sociaux, blogs, commentaires, enquêtes / sondages, …

…

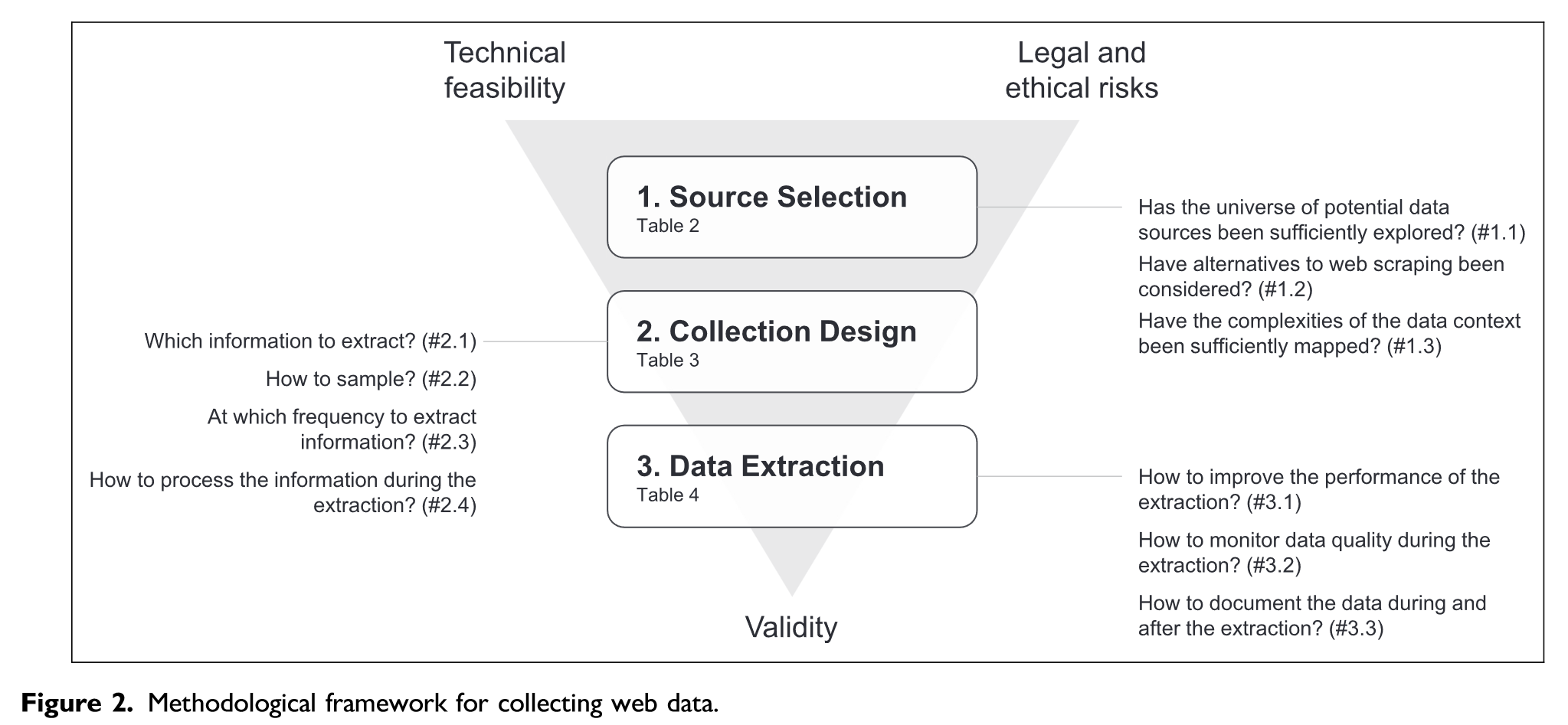

Comment constituer les corpus ?

Datasets, bases de données, APIs, enquêtes, webscraping, …

1. Quelles sources de données ?

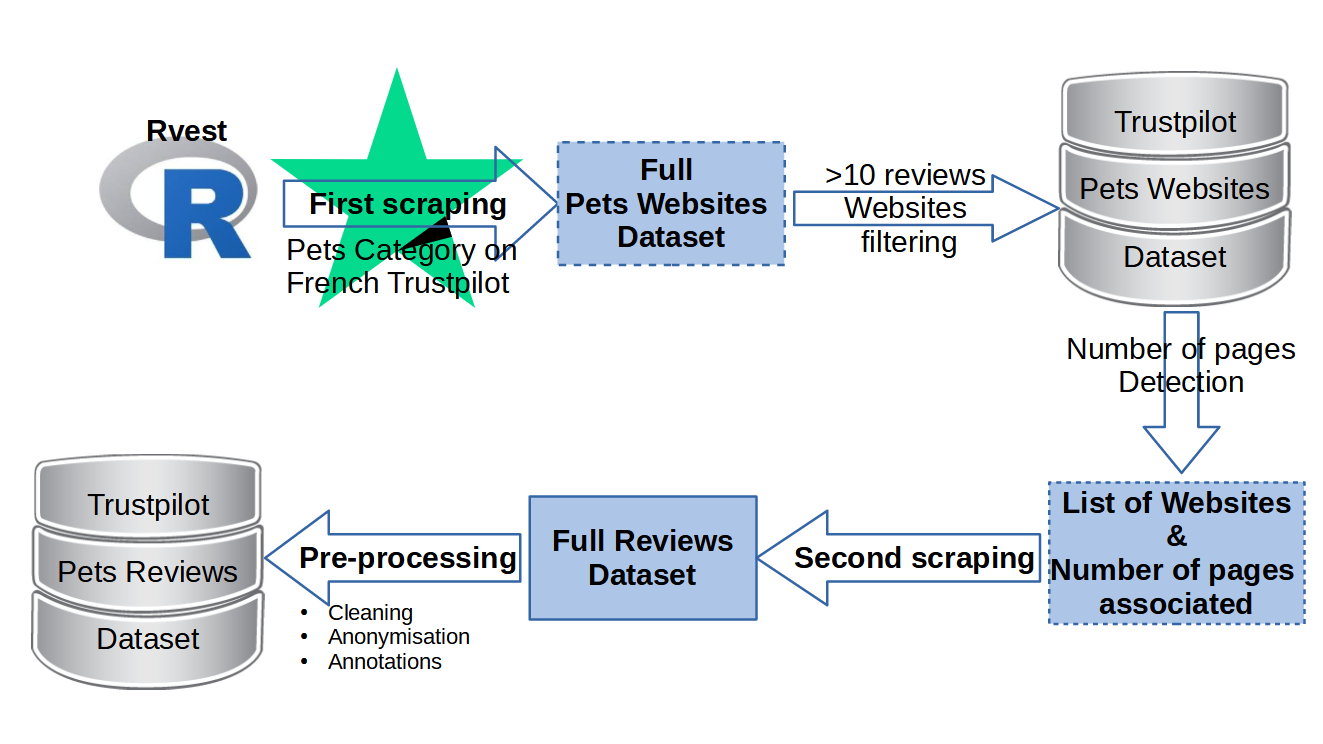

1. Quelles sources de données ?

341 613 avis clients concernant 220 sites web

2. Quelles applications ?

Quelques exemples, non exhaustifs :

| Bibliométrie | Études qualitatives | Études quantitatives |

|---|---|---|

| Revue de littérature systématique | Explorer les concepts, les discours | Transformer le texte en indicateurs |

| Analyse des mots-clés, des abstracts | Mots fréquents, co-occurences | Comptage simple |

| Identifications des thématiques récurrentes | Identification des thématiques | Probalités associées aux topics |

| Réseaux d’auteurs, de citations, de références | Réseaux sémantiques | Métriques des réseaux |

Une collection d’outils d’analyse pour répondre à une problématique de recherche

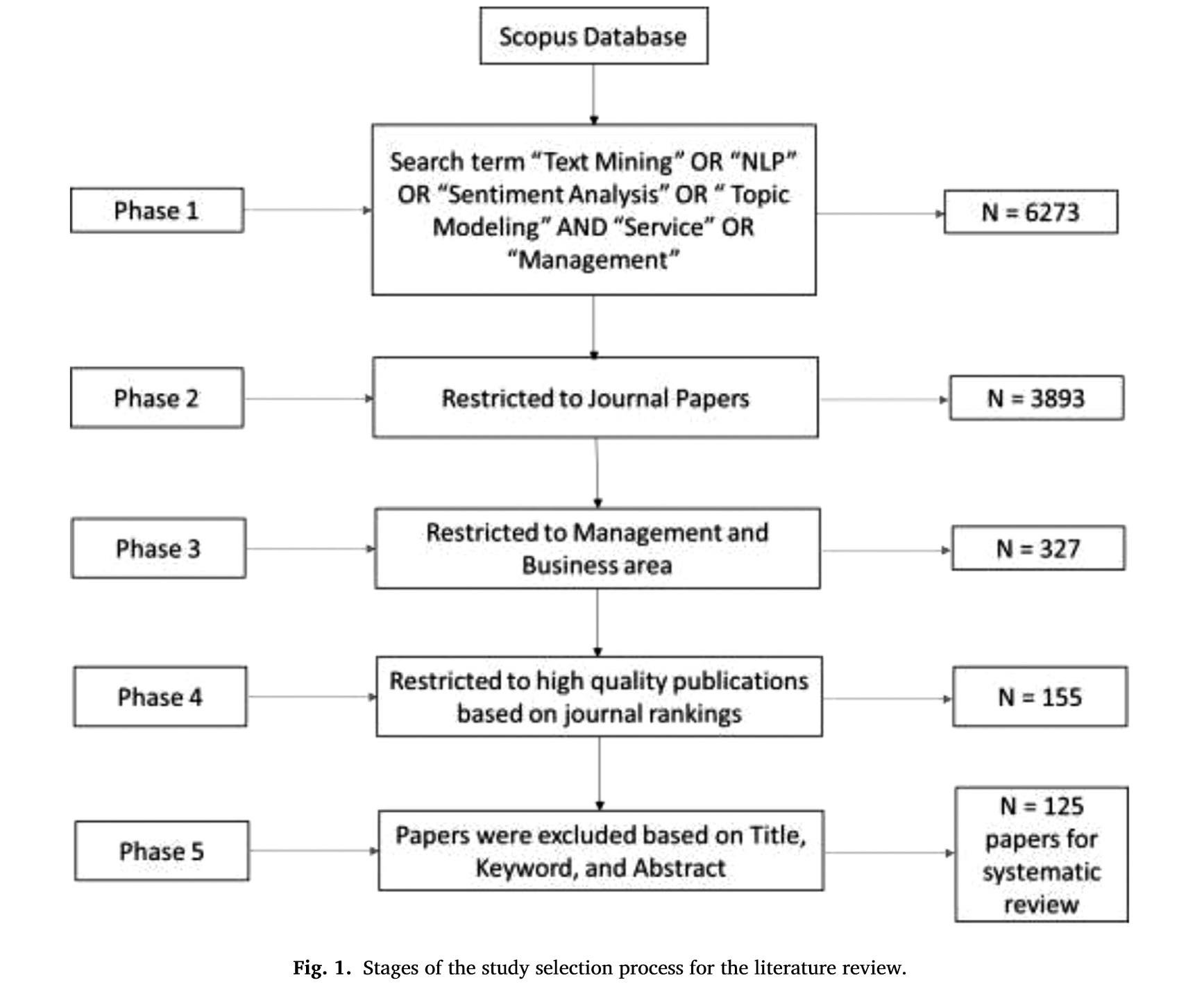

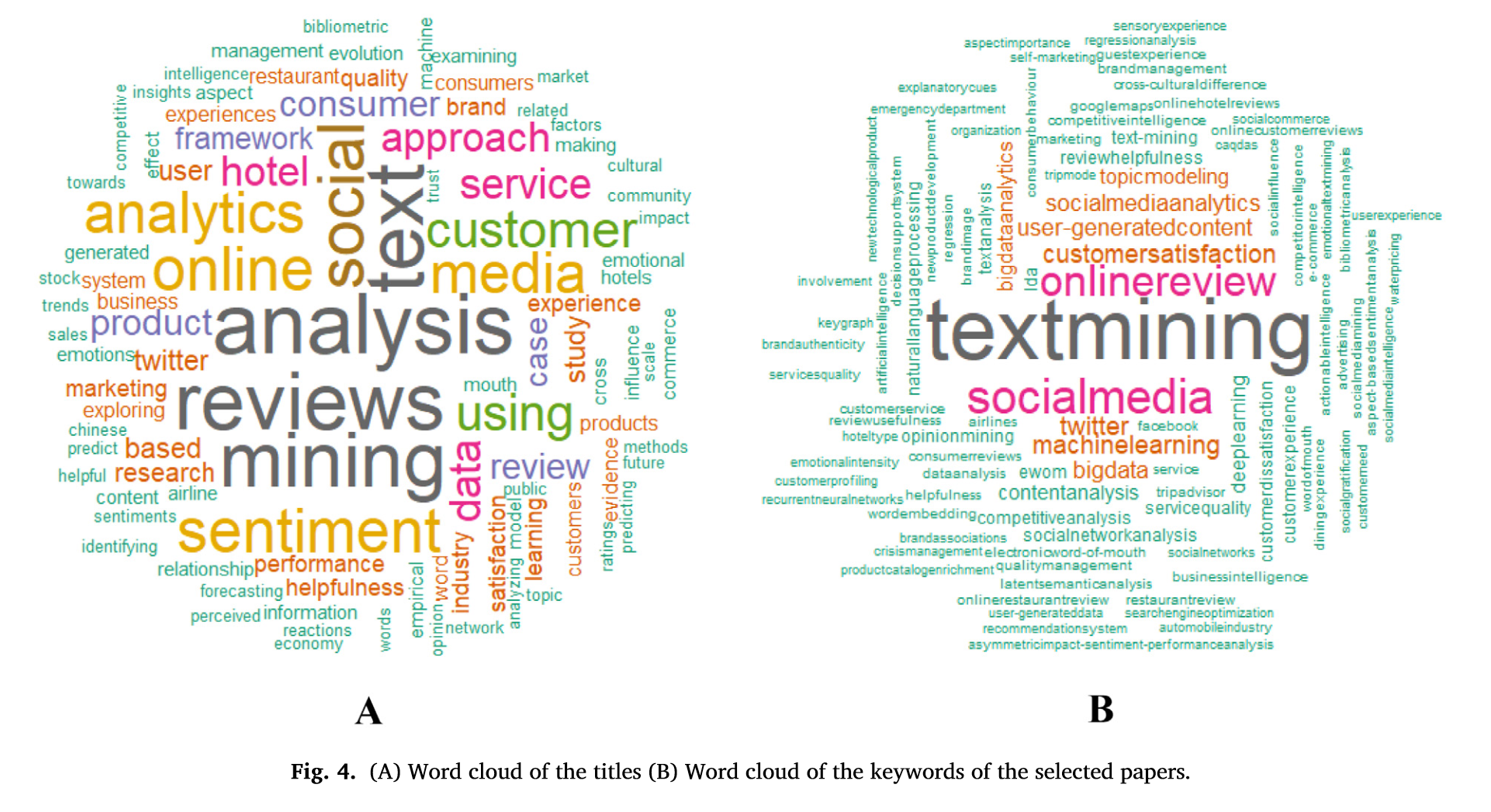

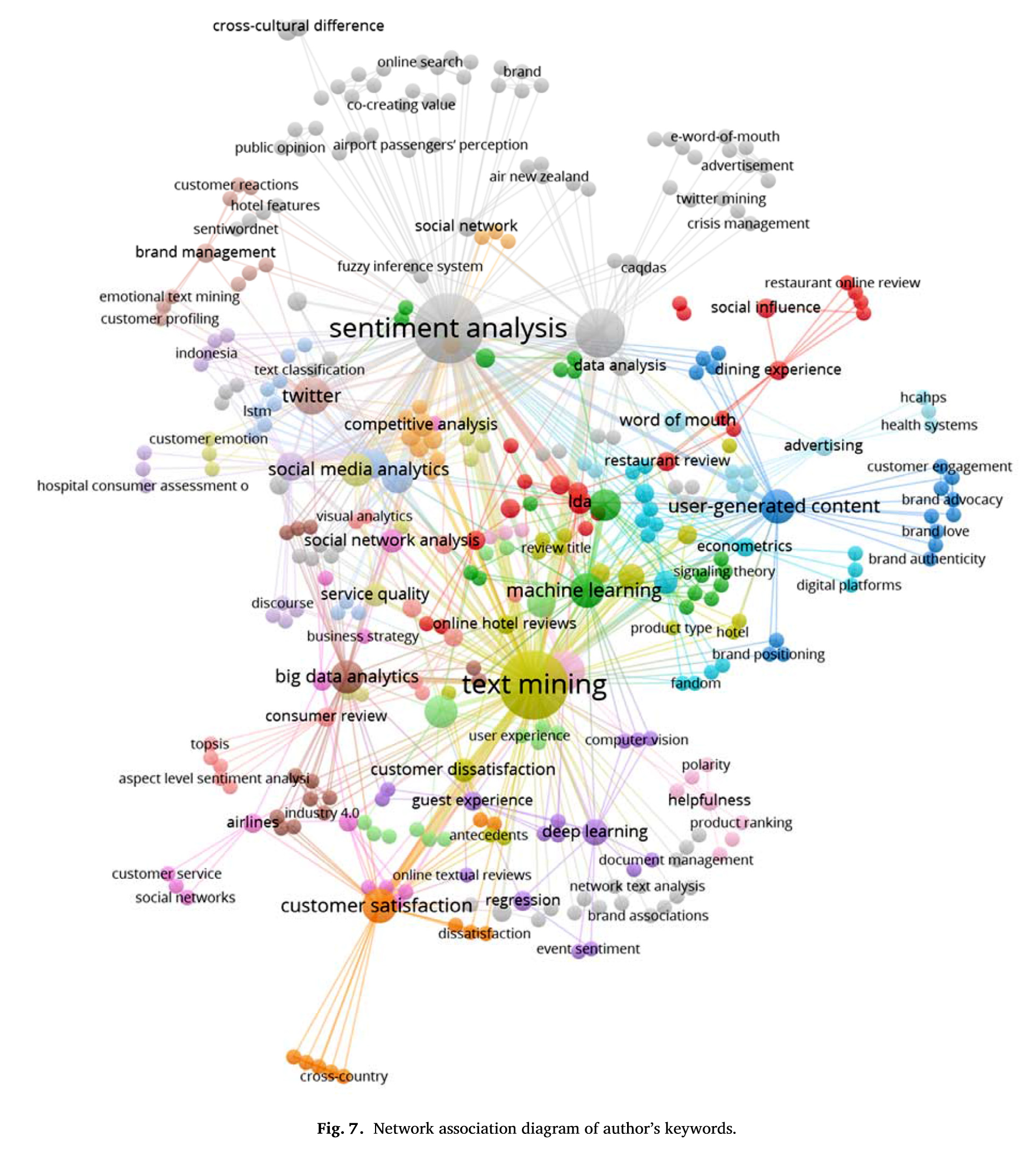

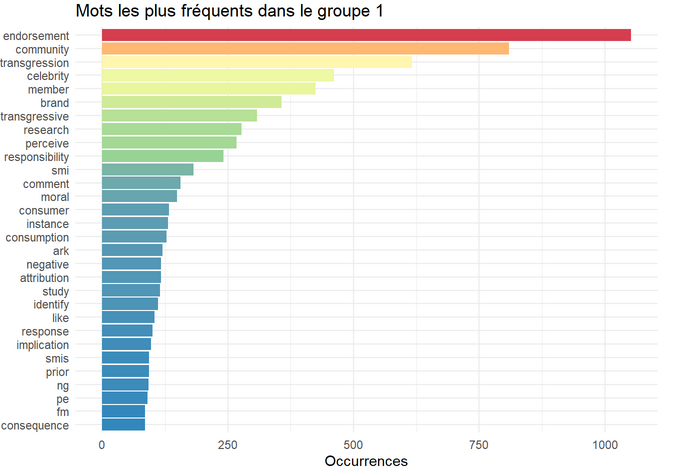

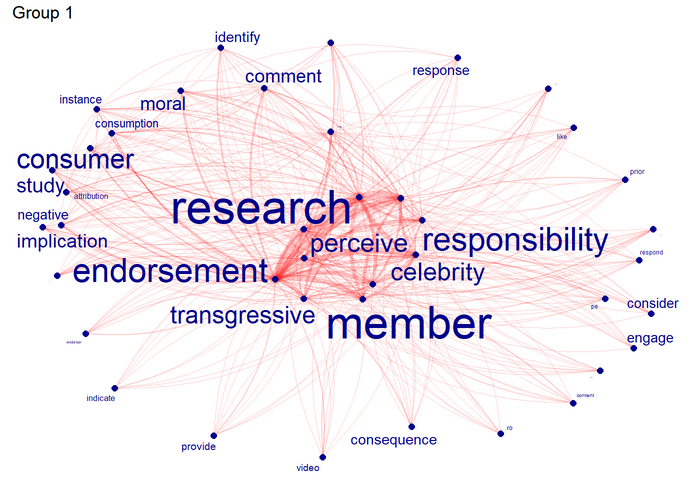

2. Quelles applications ?

Revue de littérature systématique

2. Quelles applications ?

Études qualitatives

2. Quelles applications ?

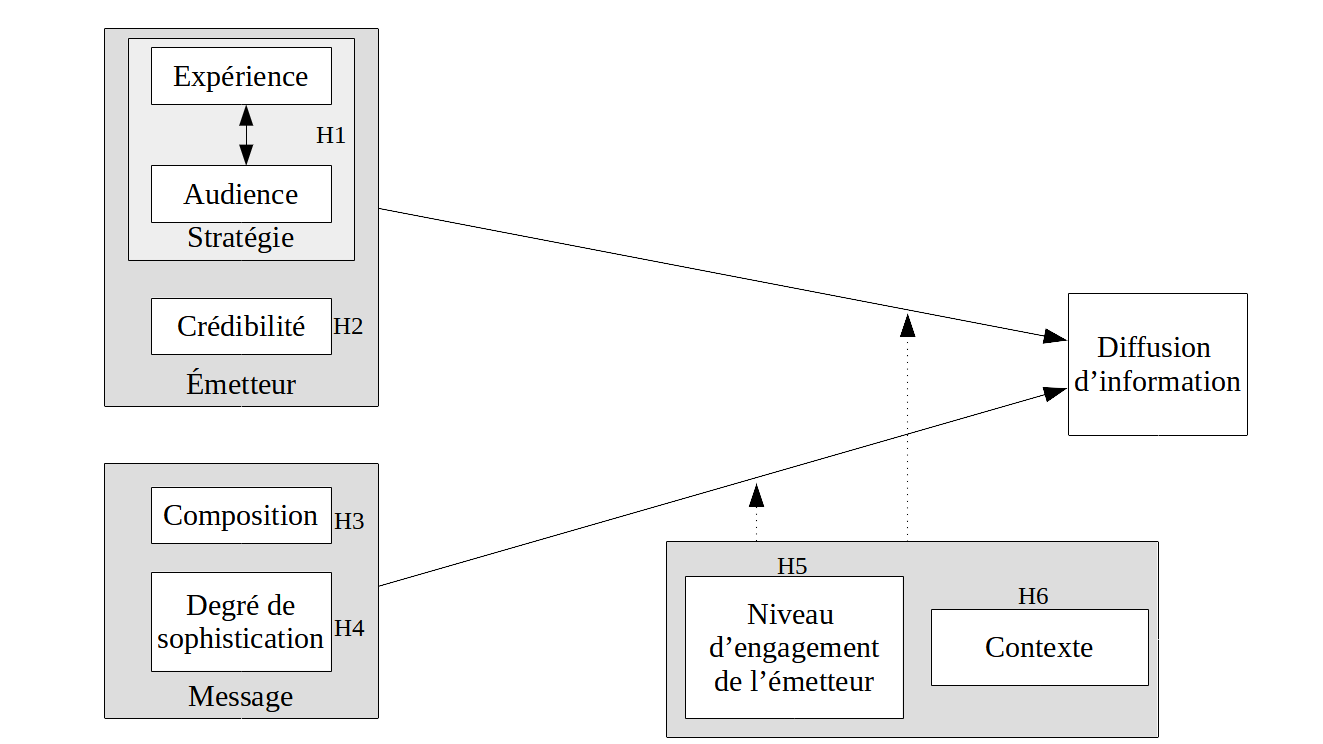

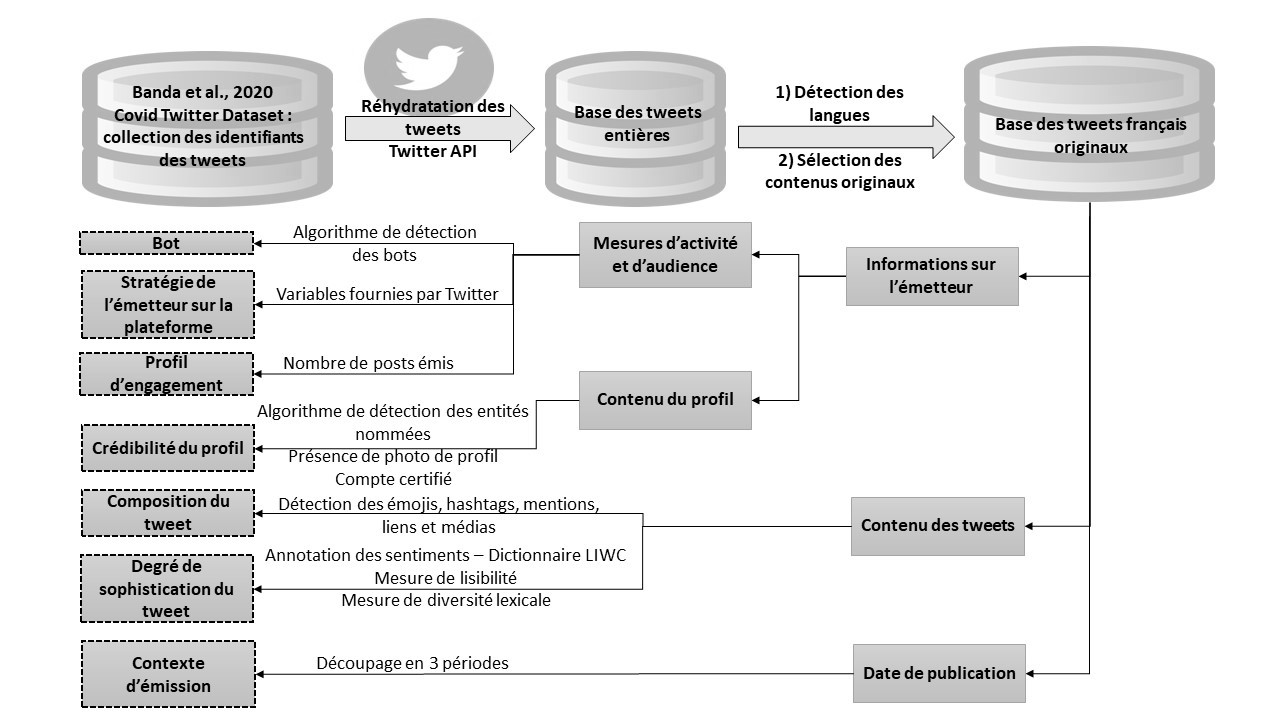

Études quantitatives

2. Quelles applications ?

Études quantitatives

3. Quelles méthodes d’analyse ?

Corpus : une collection de documents

Document : une collection de tokens + des métadonnées

Des hypothèses sur la distribution des mots dans les documents

2 grandes approches du texte :

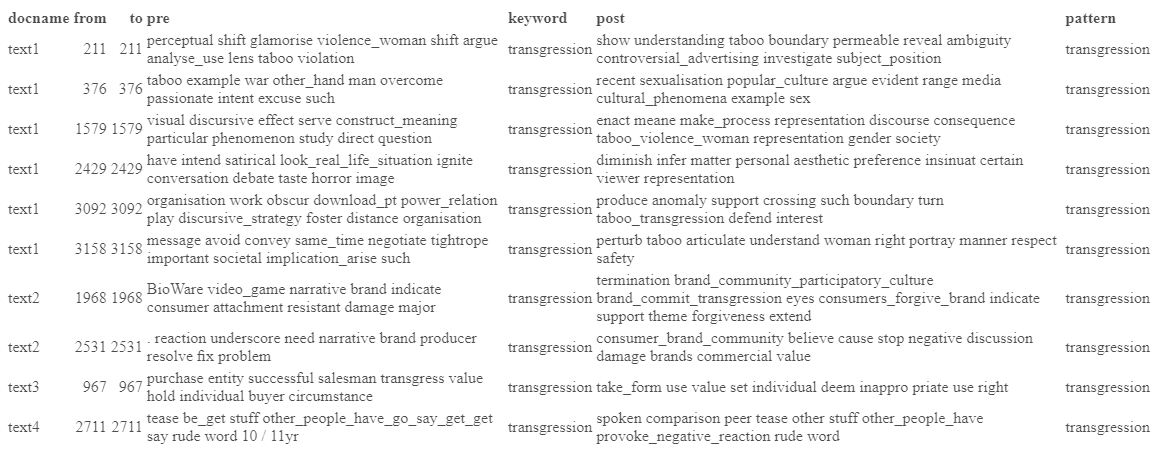

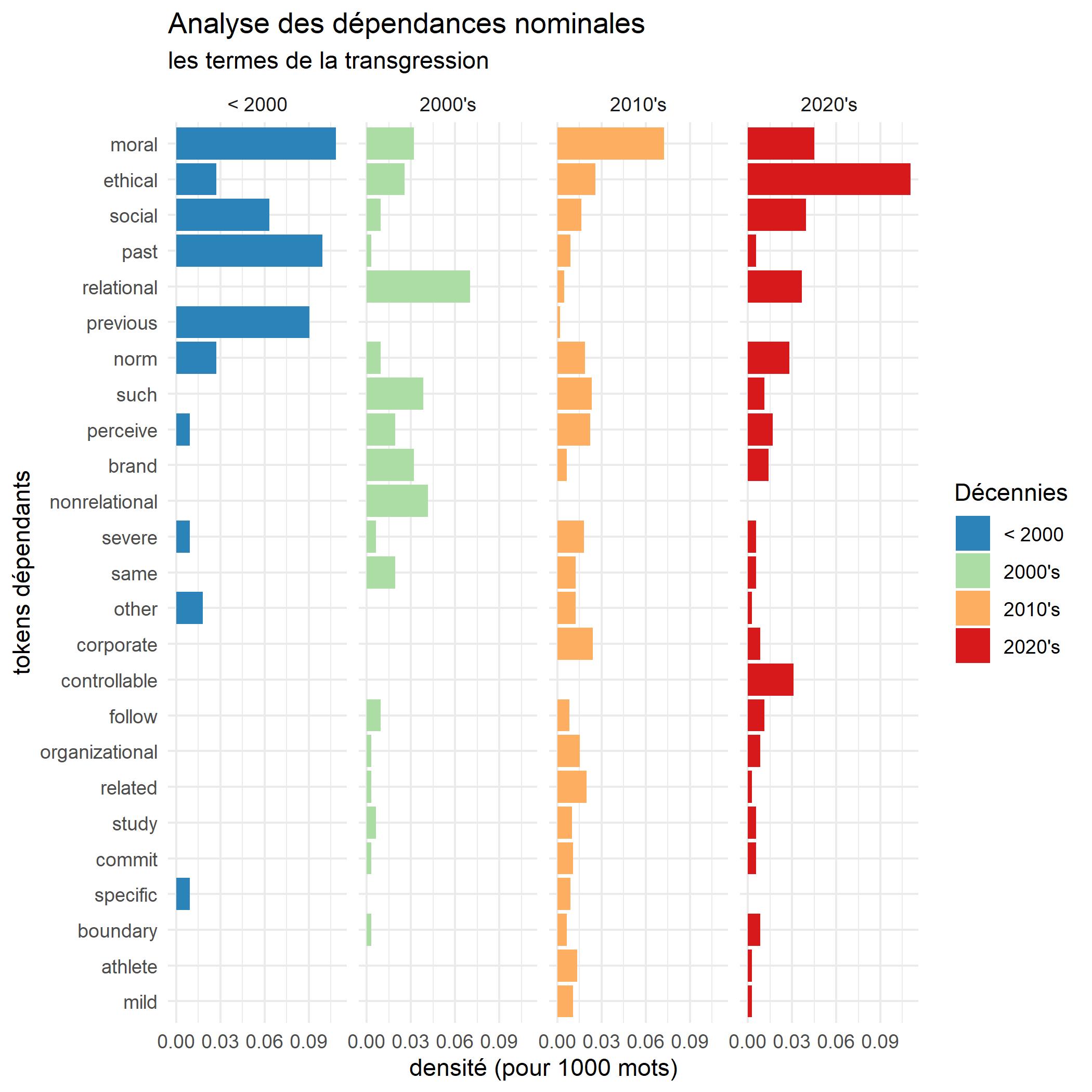

Syntaxique : prendre en compte la fonction du mot et sa place dans la phrase

Bag of words : un document est un ensemble de tokens

3. Quelles méthodes d’analyse ?

3 grandes familles d’outils :

À partir des fréquences : wordcloud, co-occurrences, modèles de topics, embeddings

À partir de l’annotation : construction des phrases, réseaux sémantiques, dépendances syntaxiques, entités nommées, analyse du sentiment, approches par dictionnaire, classification

Stylométrie : mesures de lisibilité, de diversité lexicale, longueur de phrases, utilisation des pronoms, des émojis, la casse, la conjugaison, …

Les étapes de l’analyse :

- Constitution du corpus

- Pré-traitements

- Annotations

- Analyse à proprement parler

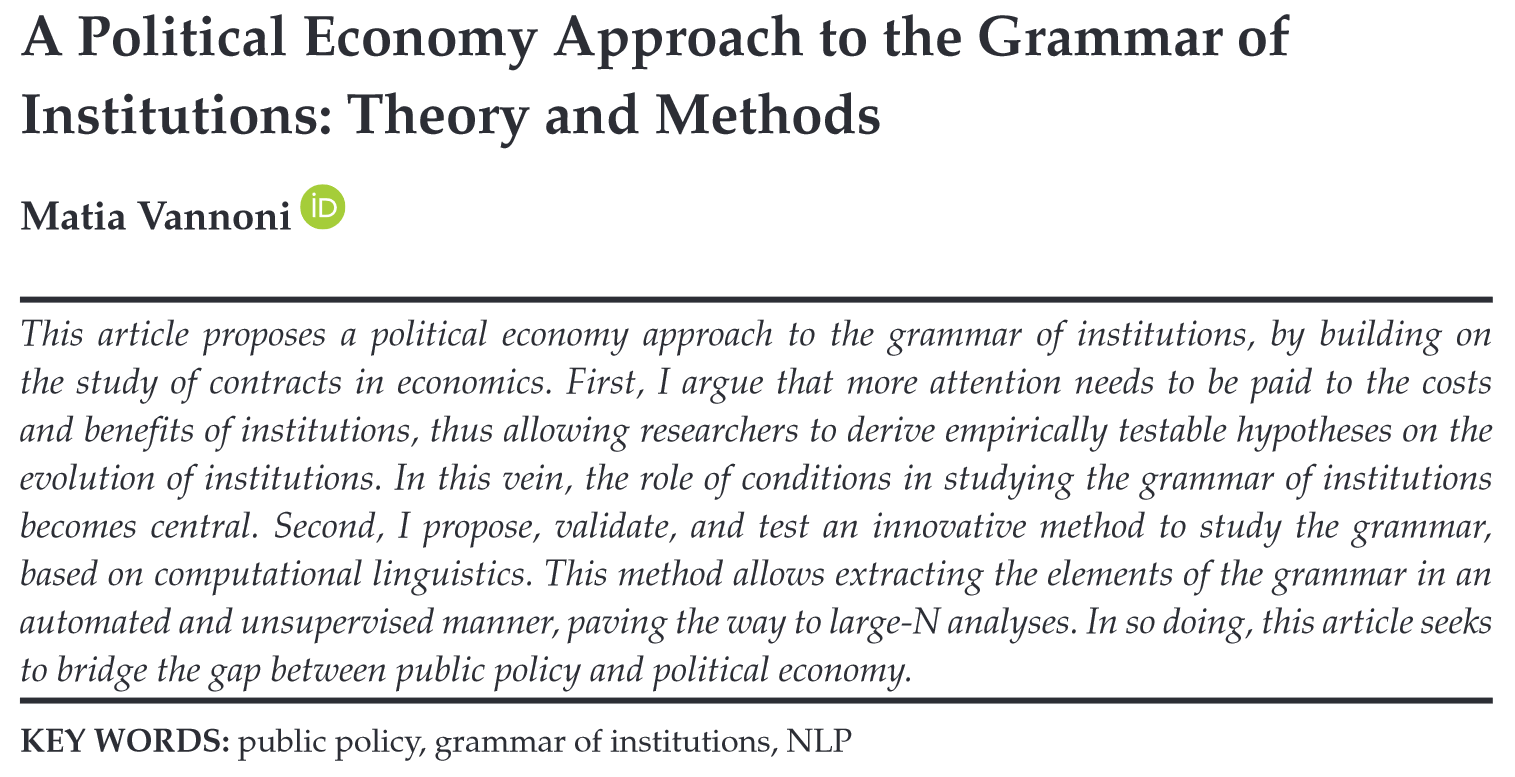

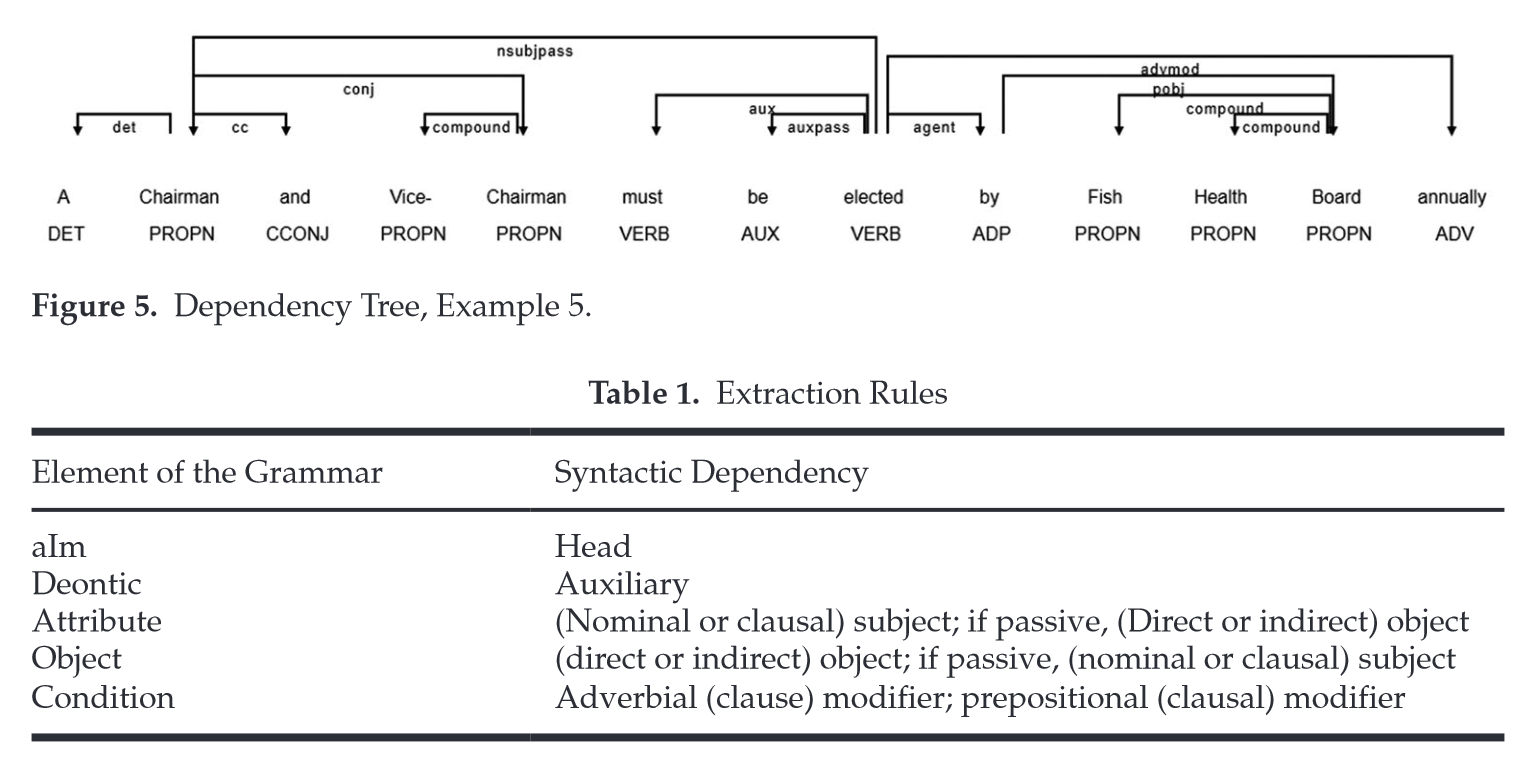

3. Quelles méthodes d’analyse ?

QR : technological innovation increases the number of economic

conditional clauses

Corpus : the whole U.S. state legislation from 1964 to 2000

3. Quelles méthodes d’analyse ?

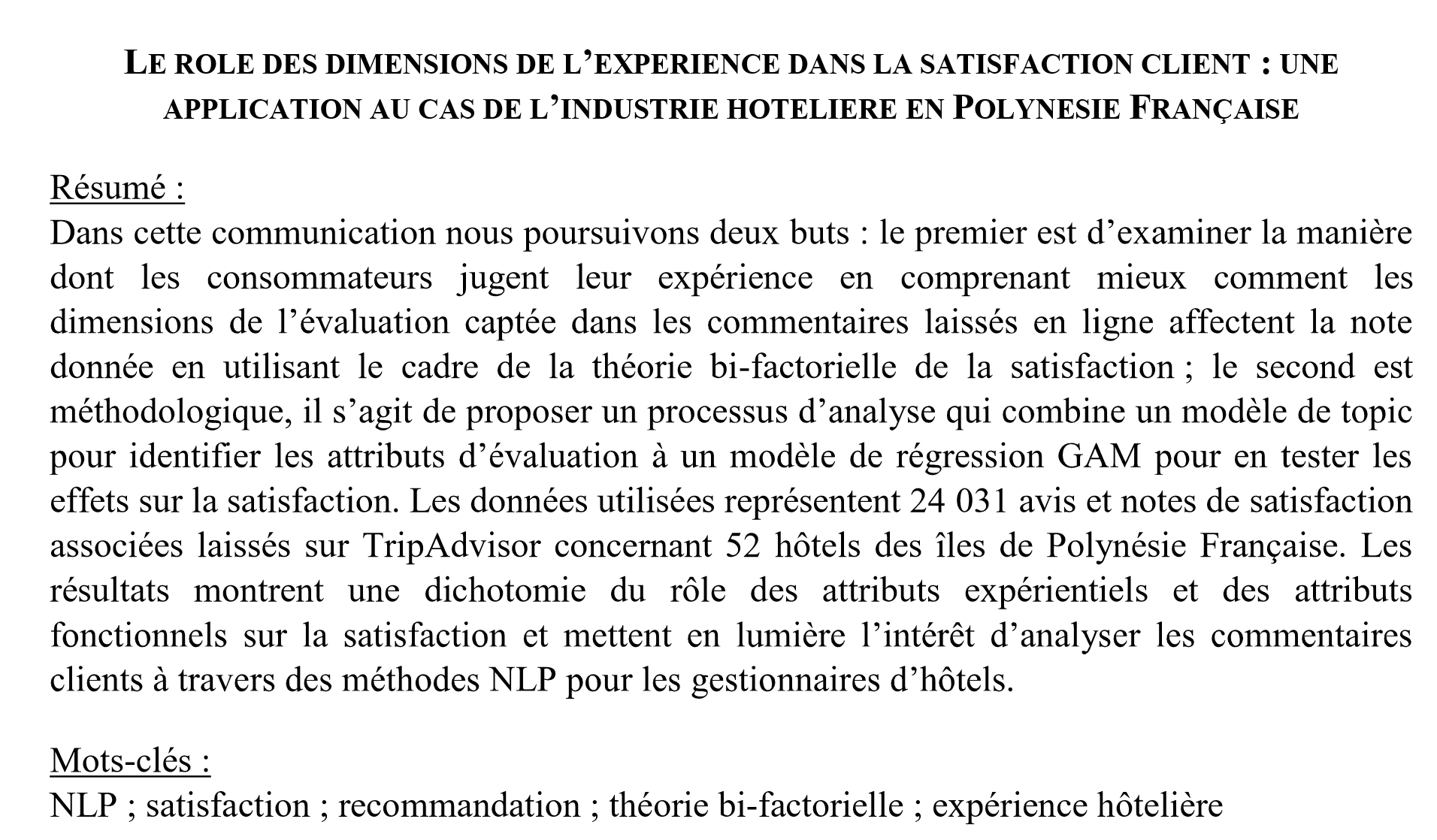

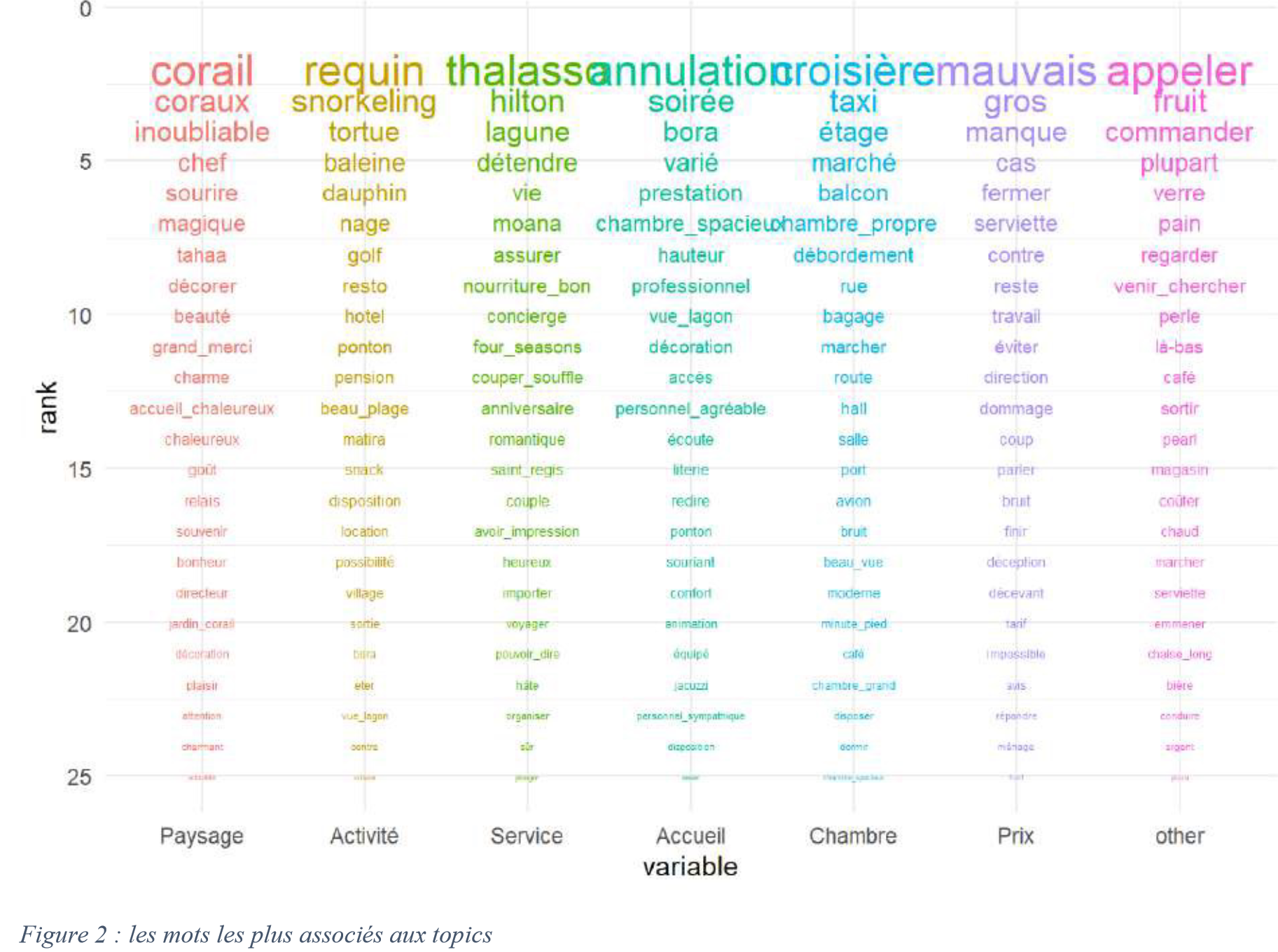

QR : quelle est la contribution des attributs clés de l’expérience

hôtelière à la satisfaction ?

Corpus : 24 301 commentaires de Trip Advisor sur 52 hôtels

3. Quelles méthodes d’analyse ?

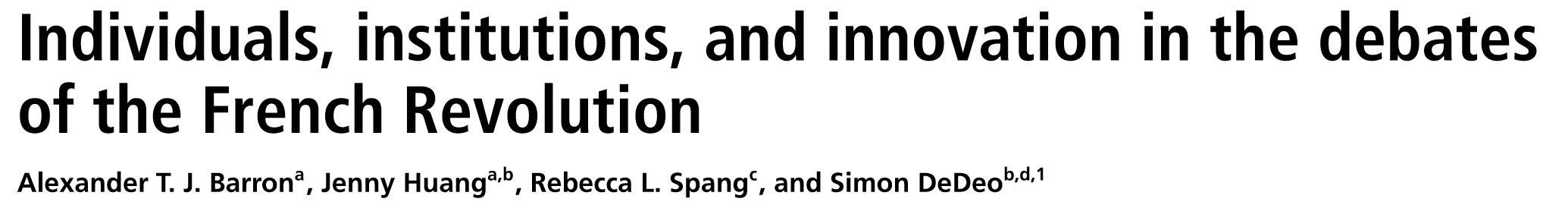

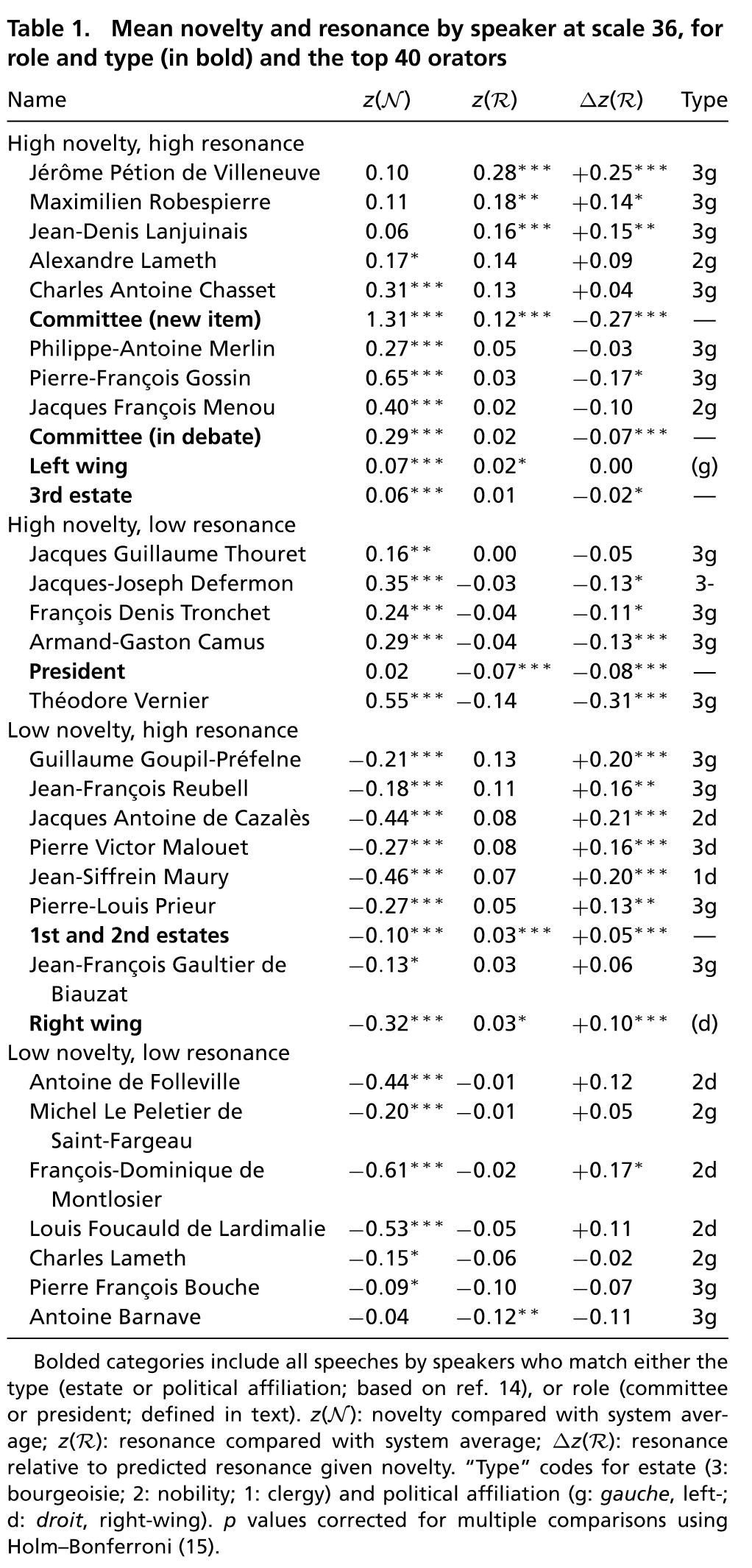

QR : how patterns of speaking are created, picked up, and

ignored or propagated

Corpus : 44,913 speeches from the Archives Parlementaires

of the French Revolution Digital Archive

from 1787 to 1794

3. Quelles méthodes d’analyse ?

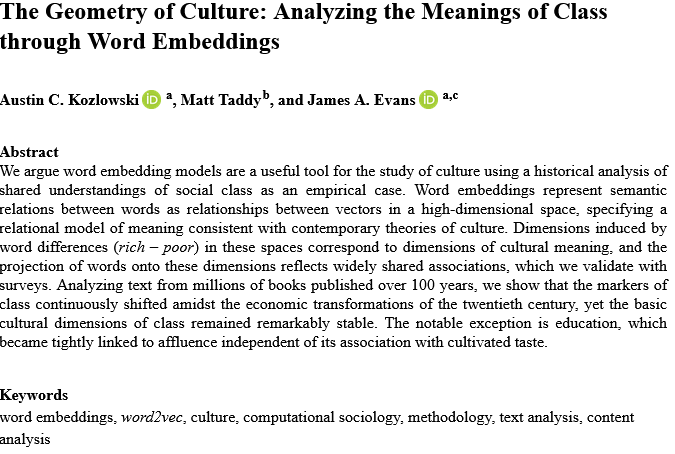

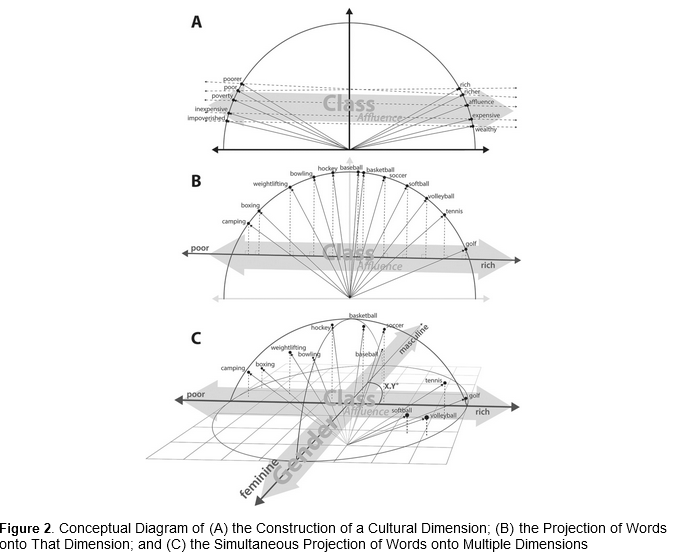

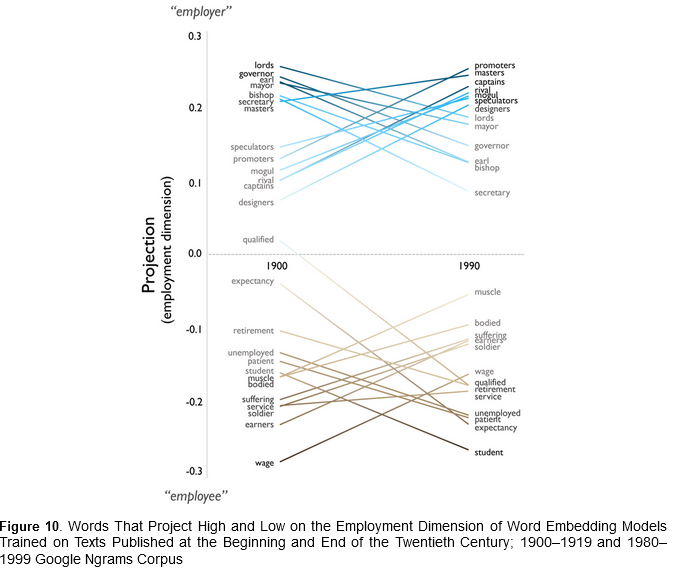

QR : analyze the cultural dimensions of social class and their evolution

over the twentieth century

Corpus : survey of cultural associations to a total of 398 respondents

on Amazon Mechanical Turk + a similar dataset collected in the 1950’s

Google Ngram texts from 1900 to 2012 : collection of 5-grams

3. Quelles méthodes d’analyse ?

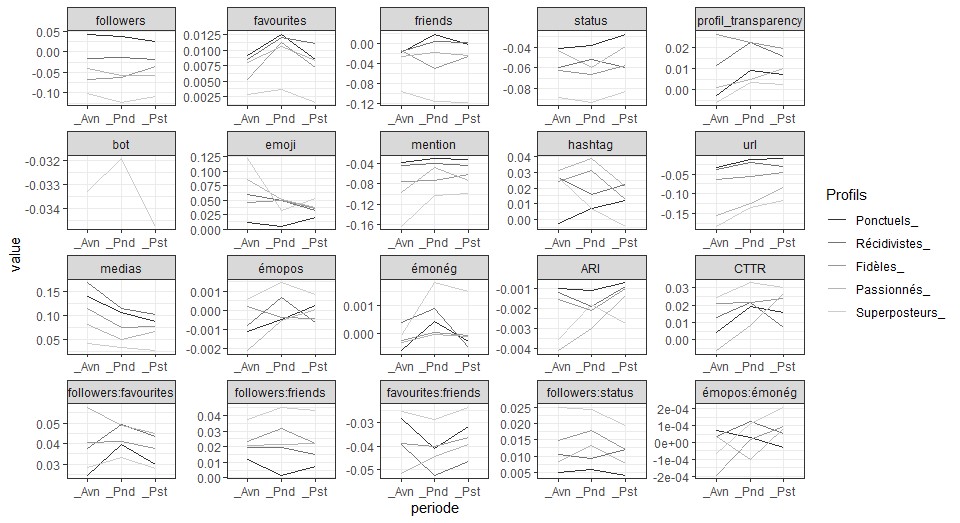

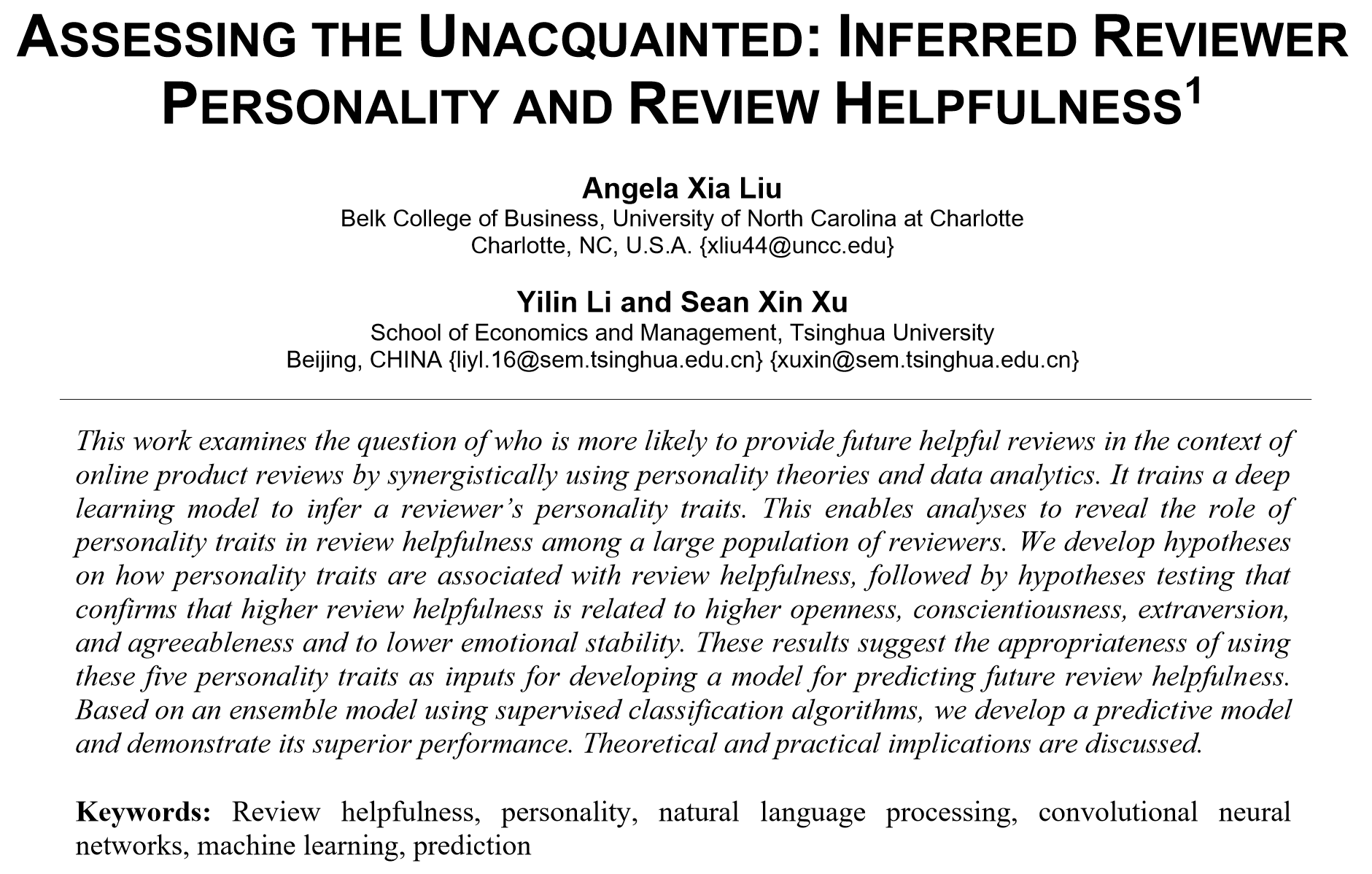

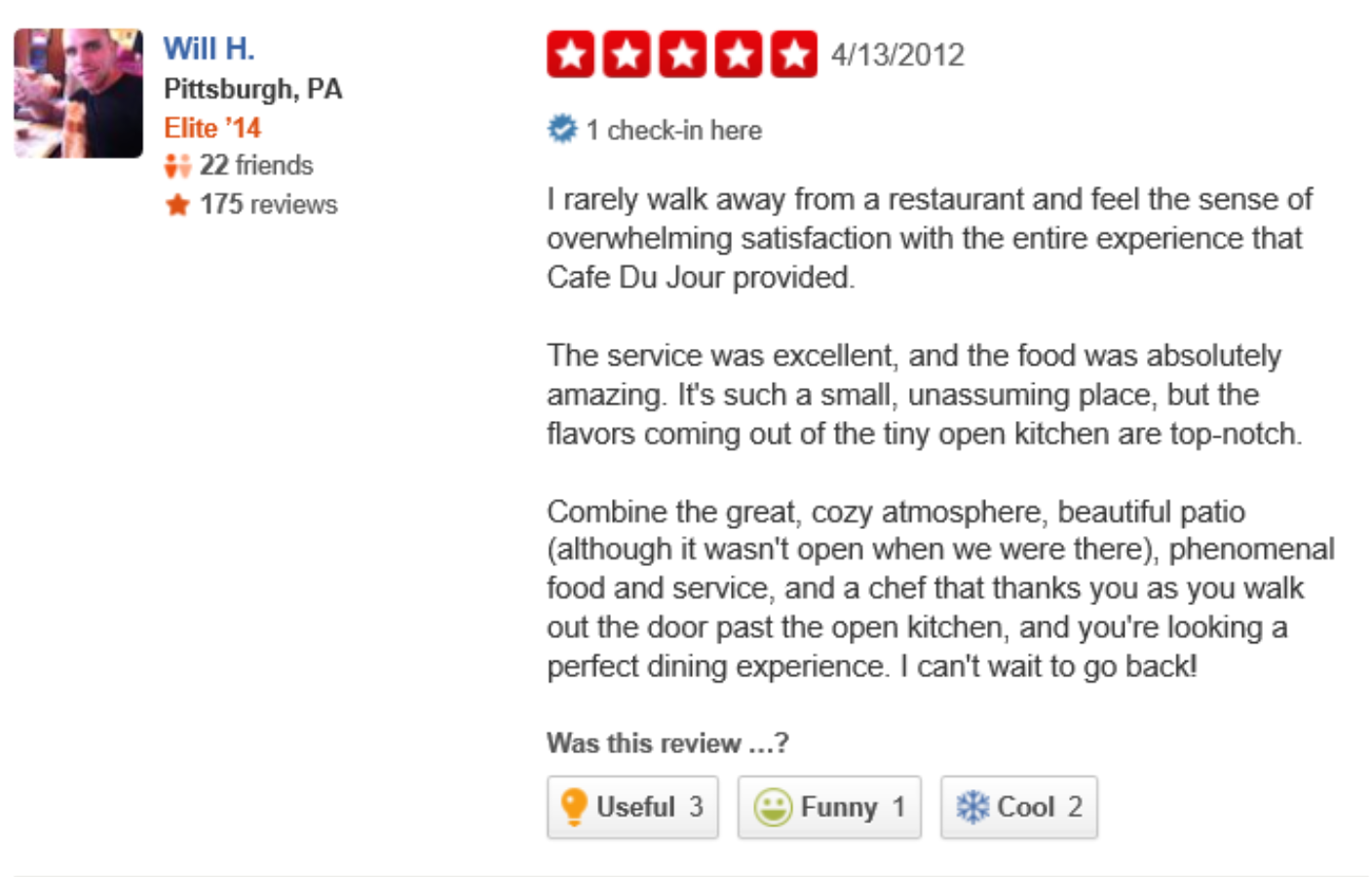

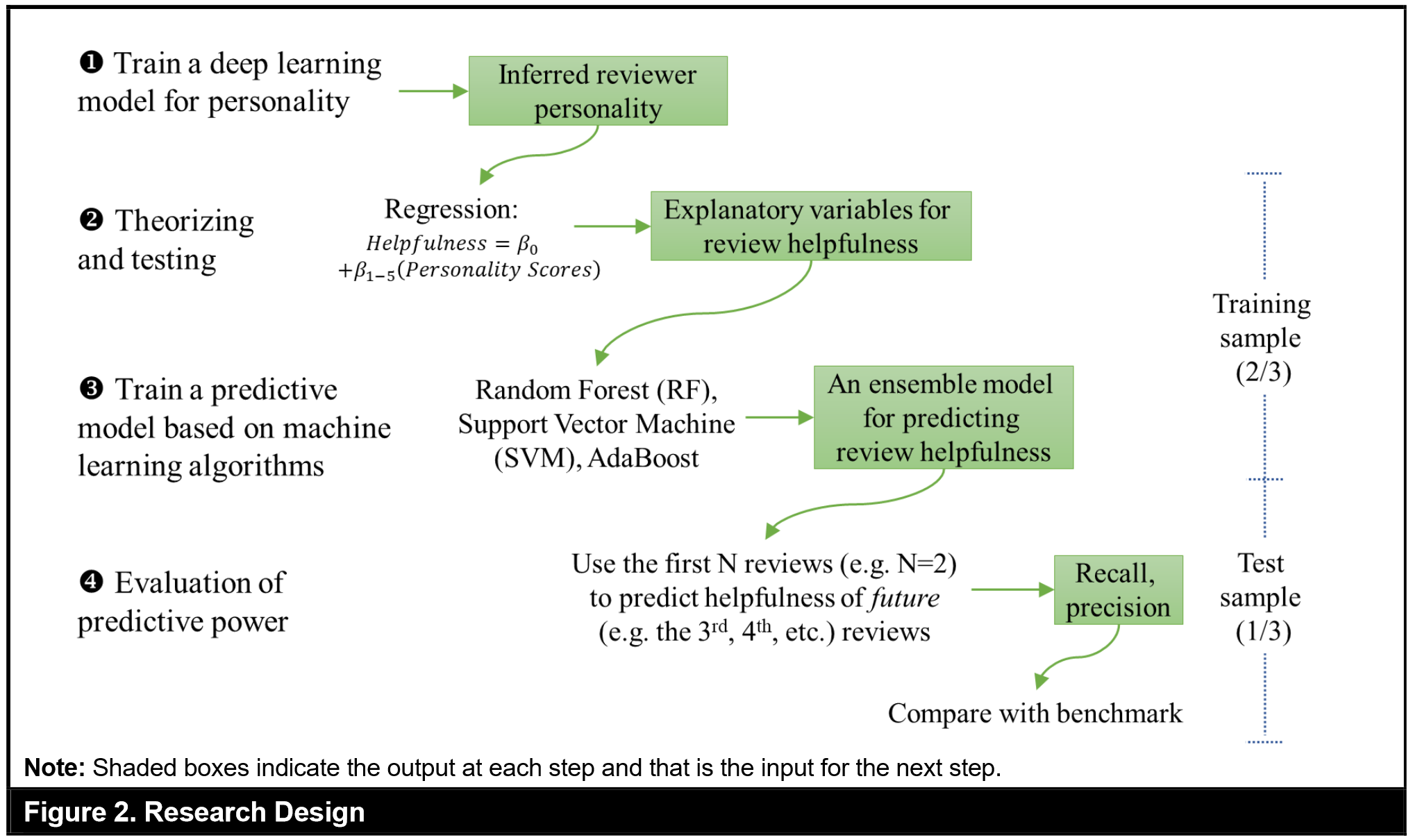

QR : investigate the predictive power of the inferred personality

for their future reviews

Corpus : Yelp Academic Dataset focused on the “restaurant” category

160,578 reviews written by 74,480 reviewers for 4,244 restaurants

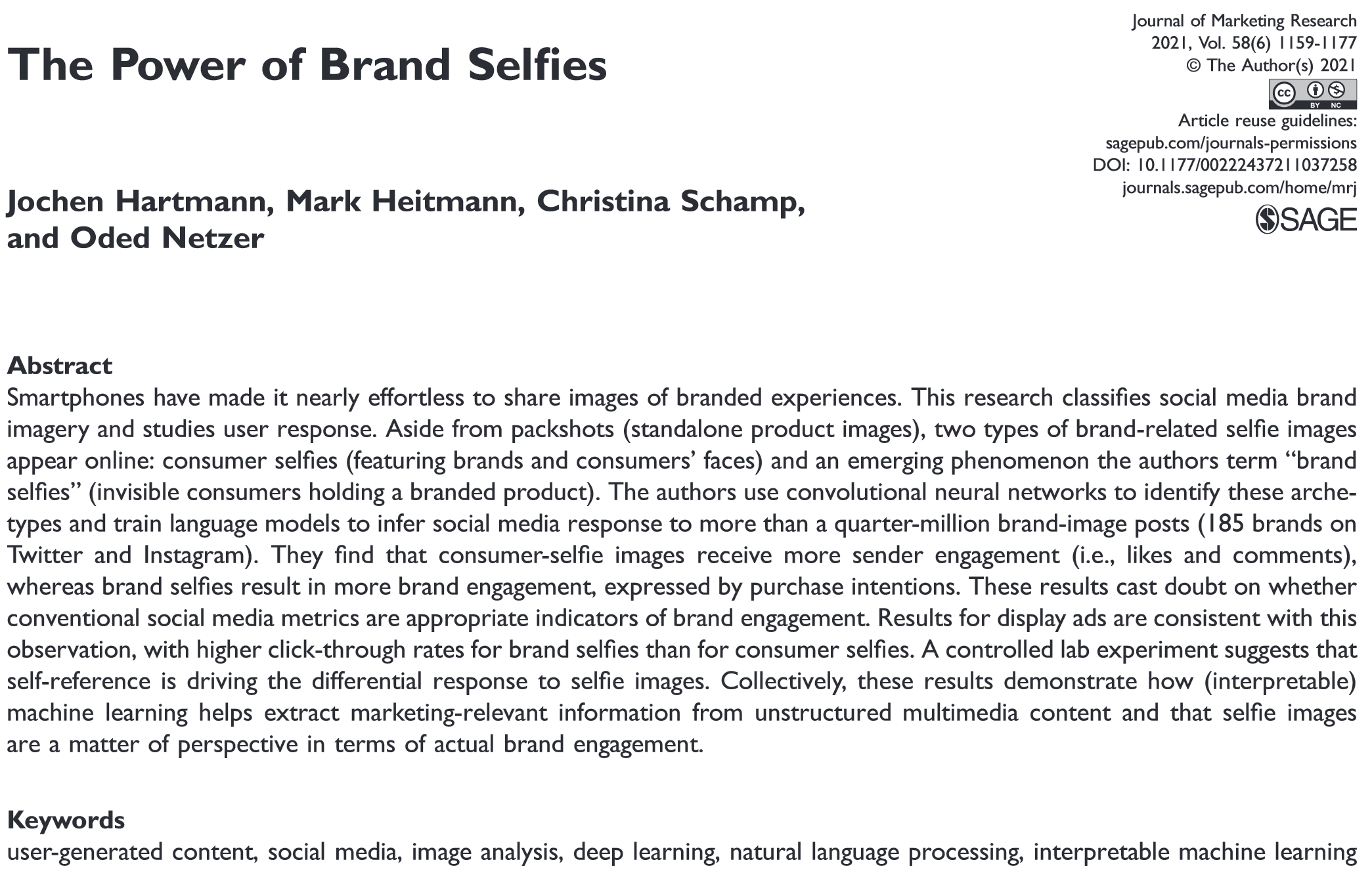

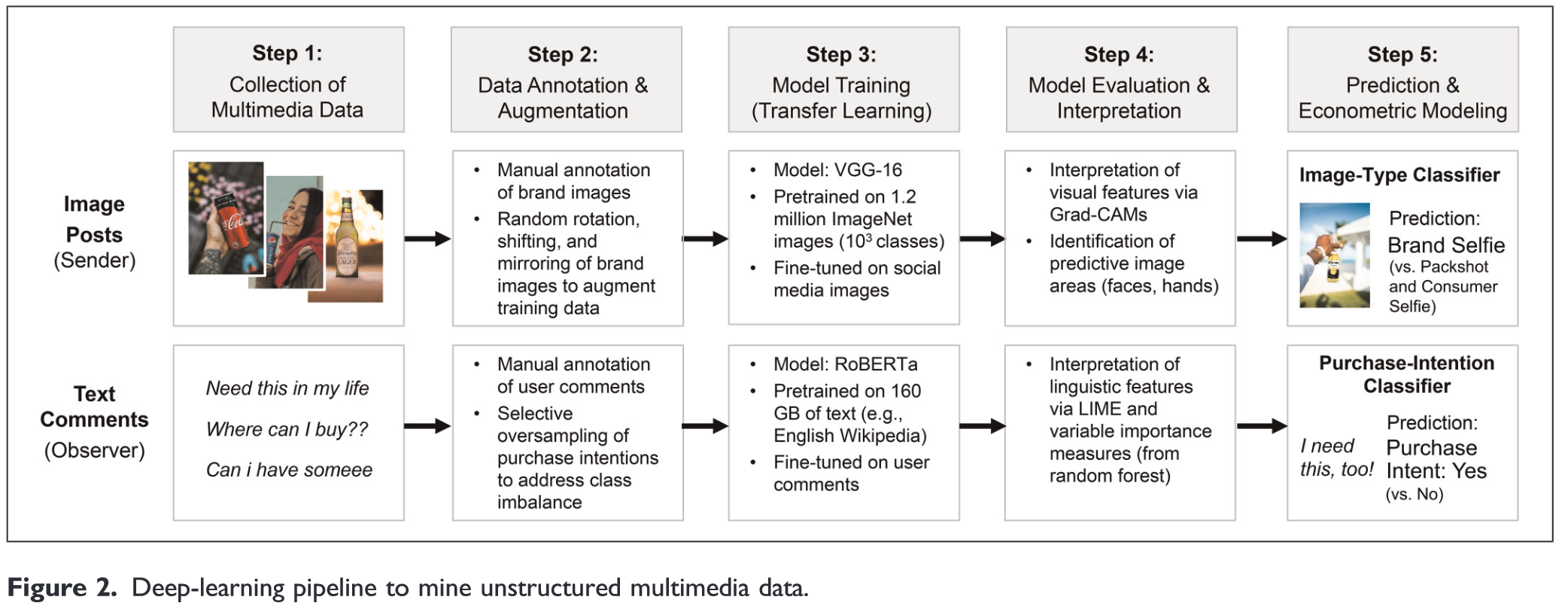

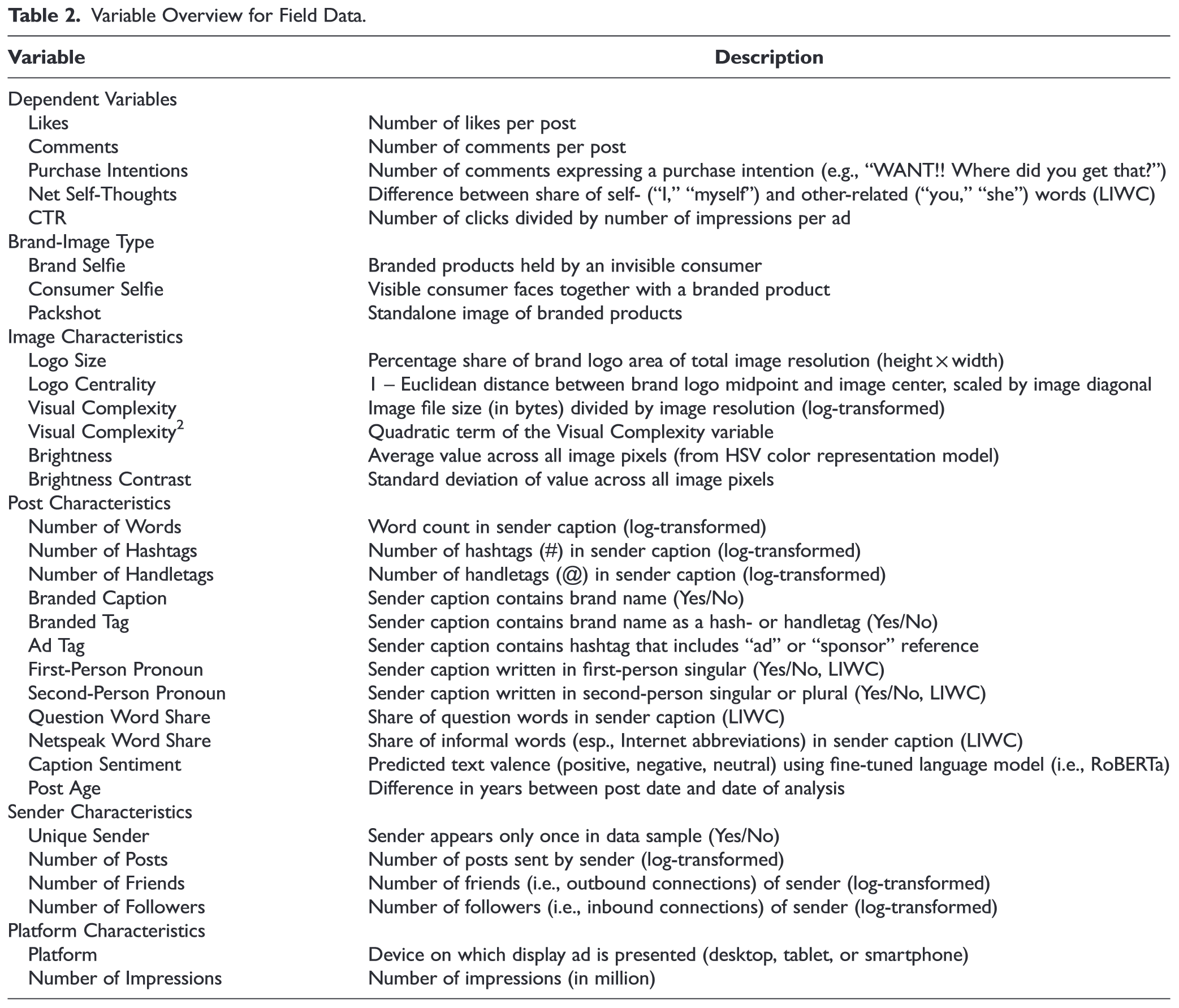

3. Quelles méthodes d’analyse ?

QR : how social media brand images relate to brand engagement

Corpus : Instagram (N = 43,585) and Twitter (N = 214,536)

with 185 visible beverages and food brands

4. Quelles difficultés ?

La disponibilités des ressources : les données, les modèles et leur documentation, les dictionnaires, …

La qualité des données : l’exhaustivité, la complétude, la fiabilité, l’orthographe, l’encodage, …

Les compétences informatiques : trouver le bon langage / le bon logiciel, trouver les données et les modèles, charger les données, comprendre la structure des données, mettre en œuvre les analyses, mettre en forme les résultats, exporter les résultats, …

Le matériel informatique et la puissance de calcul : le volume des données, le temps de calcul, les capacités de calcul, le coût énergétique / environnemental, …

Conclusion

Un panorama loin d’être exhaustif

Un vaste champs d’outils méthodologiques et d’applications possibles

De très nombreuses ressources en ligne

Une grande communauté de chercheurs de tous domaines

Merci pour votre attention

Liens

Le séminaire du Collège de France : Apprendre les langues aux machines - B. Sagot

Notre projet de livre (toujours en développement) :NLP avec r et en français - un Manuel synthétique

Un package d’OCR disponible sous R : Tesseract

Un manuel pour prendre en main R : R for data science

Un manuel en français pour prendre en main R et le tidyverse : Introduction à R et au tidyverse

Un manuel pour du text mining en R : Text Mining with R

Un super package pour du NLP en R : Quanteda

Un article sur l’utilisation du texte et du NLP pour la recherche (certes en marketing, mais très intéressant pour tous) : Uniting the tribes: Using Text for Marketing Insight

Références

Atelier méthodologique du CRIISEA - 8 février 2024